Pour les news relatives aux Technologies, procédés, découvertes, actualité et situation en hardware, cliquez iciPour les news relatives aux CPU et GPU des ordinateurs portables, cliquez iciPour les news relatives aux évolutions dans le stockage informatique, cliquez ici Bienvenue à tout le monde! Vous êtes sur le topic unique des GeForce 40nm Haut de gamme, bonne lecture

************************************************************************************

[#c60038]Préalablement, pour savoir de quoi on parle

allez au post dédié aux définitions et précisions sur les termes employés[/#c60038]

[#63009b]

Petit résumé de la situation pour ceux qui ne sont pas comme nous, à surveiller la moindre nouvelle, 24h sur 24 ; [/#63009b]Il y a 2 concepteurs de cartes graphiques sur le marché, du moins les 2 principaux, avec des produits dit "grand public" ;

[#63009b] ATI[/#63009b] (racheté par AMD) et

[#63009b]nvidia[/#63009b]. Nvidia, aprés avoir noyé le consommateur sous une pétoirade de références articulées autour de son ancienne puce dite "G80" avait sorti en Juin 2008 son nouveau bébé le GT200. Une puce énorme, gravée en 65nm (nanomètres), consommant énormément. Si les performances étaient au rendez-vous, la consommation électrique et la chauffe des cartes graphiques basées sur cette puce étaient délirantes. ATI, pendant ce temps, ne communiquait pas sur sa nouvelle puce censée concurrencer ce monstre jusqu'à son lancement, approximativement au même moment. Son nom ? RV770. Gravée aussi en 55 nanomètres, sa puce était presque 2 fois plus petite que le GT200, très performante, bien moins chère à produire, consommant moins. Si les performances étaient encore à l'avantage de Nvidia, le coût des cartes et surtout le rapport qualité/prix était en faveur d'ATI. Le caméléon (symbole de nvidia) venait de se prendre un coup aux fesses... Et répliqua plus tard avec une nouvelle révision de son GT200, nommé GT200B, gravé non plus en 65nm mais en 55nm. Même si la puce consommait moins, son prix, deux fois plus cher que le RV770, semblait la réserver à une clientèle de joueurs confirmés ou de personnes aisées. Un peu plus d'un an après, aujourd'hui, les nouvelles gammes arrivent. Le RV770 d'ATI est remplacé par le RV870 gravé non plus en 55nm mais en 40nm. Résultat ? Les problèmes du RV770 ont été corrigés ; Consommation électrique faible, performances au rendez-vous ; ATI a réussi à amener un successeur de choix à son ancienne gamme. En face, nvidia bossait sur ce qu'on pensait être le GT300, successeur du GT200, puce énormissime connue sous le nom de code "FERMI" dont la taille même lui a posé un problème de production (rendement), sans compter son coût. Lors de la Keynote d'ouverture de la GTC (GPU Technology Conference) le 30 Septembre 2009, à l'occasion de l'annonce des premiers détails sur l'architecture de son Fermi désormais connu sous le nom GF100, nvdia a clairement annoncé la couleur ; une carte graphique pour joueurs n'est plus sa priorité (mais ne délaisse pas ce marché pour autant.) Le marché pro en revanche revête pour lui d'une plus grande importance car bien plus rentable. Cette précision a de quoi faire grincer les dents. Cependant le site d'Anandtech nous a apporté une précision cinglante à ce sujet :

Citation :

"... many of the architectural features of Fermi are targeted specifically for Tesla markets. ... Yet Tesla accounted for less than 1.3% of NVIDIA's total revenue last quarter. Given these numbers it looks like NVIDIA is building GPUs for a world that doesn't exist." - Anandtech

Traduction ; La plupart des caractéristiques du GF100 "Fermi" cibleraient spécialement le marché Tesla... A ce jour, ce marché représente moins de 1,3% des revenus de nvidia...

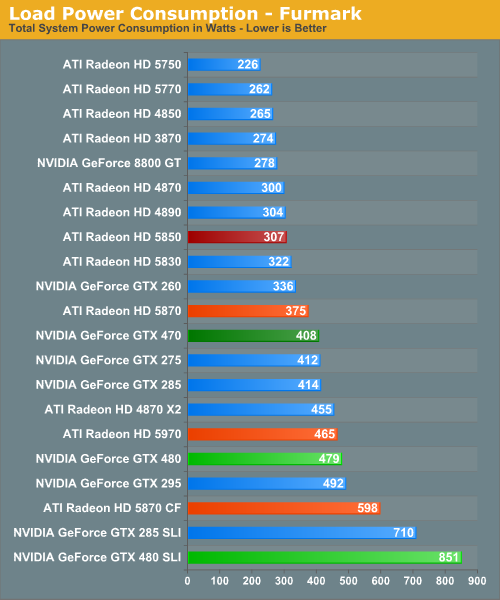

Au final les GTX 470 et 480 font un peu penser à la GTX280 ; chauffe, conso et bruit laissent à désirer mais cela permet néanmoins à nvidia de revenir concurrencer le RV870 d'ATI. Nos yeux sont maintenant rivés sur des "révisions" de cette 480, comme on a pu connaitre le cas avec les 285 corrigeant les points noirs de la 280. On parle de fin 2010 pour ce faire.

****************

****************

[#71008d]

Les différences des cartes :[/#71008d]

****************

****************

****************

****************

[#71008d]

Le Die du Fermi :[/#71008d]

****************

****************

Voltages :

Desktop 50 MHz 68 MHz 101 MHz 0.96 V

Blu-Ray Playback 405 MHz 162 MHz 810 MHz 0.99 V3D Load 700 MHz 924 MHz 1400 MHz 0.99 V

****************

****************

[#71008d]

Les cartes :[/#71008d]

****************

****************

****************

****************

[#71008d]

Les Tests / Dossiers :[/#71008d]

****************

****************

[#63009b]Tests Français :[/#63009b]-

http://www.hardware.fr/articles/787-1/d ... x-480.html-

http://www.pcworld.fr/article/materiel/ ... st/481611/-

http://www.erenumerique.fr/geforce_gtx_ ... 603-1.html-

http://www.clubic.com/article-332014-1- ... vidia.html[#63009b]Tests Anglais :[/#63009b]-

http://www.techpowerup.com/reviews/NVID ... rmi/1.html-

http://anandtech.com/video/showdoc.aspx?i=3783&p=1-

http://hothardware.com/Articles/NVIDIA- ... ed/?page=1-

http://www.pcper.com/article.php?aid=88 ... pert&pid=1[#0000ff]Citations émanant des conclusions de plusieurs tests :[/#0000ff]Citation :

Pour conclure, nous dirons qu’il ne sert à rien de se ruer sur la GeForce GTX 480 car même si elle peut revendiquer le titre de carte graphique la plus puissante du moment, sa consommation et sa dissipation thermique n’en font pas une carte pour le moment indispensable. Une Radeon HD 5870 nous semble plus homogène même si la GTX 480 est mieux armée sur le long terme avec ses 1536 Mo de mémoire. Mais si vous pouvez retarder votre achat de plusieurs mois, faites-le car Nvidia devrait sortir une révision B de son Fermi durant l’été avec qui sait à la clé 512 shader processors actifs et une consommation en baisse. La firme au caméléon nous refera peut-être le coup de la GeForce GTX 285 sortie peu de temps après la GTX 280 avec une prochaine GTX 485. Wait and see…

source ; pcworld

Citation :

50% de transistors en plus, 38 watts de plus au repos, 102 watts de plus en charge, la GTX 480 est une carte mono GPU qui utilise les standards de consommation, de chauffe, et de bruit d’un bi-GPU ! Avec des heat pipe que l’on mesure au-delà de 70° en charge, une plaque qui frôle les 65° elle aussi et un ventilateur qui atteint les 3000 rpms passé deux minutes de test, le tout dans un boitier ouvert, la GeForce GTX 480 doit être comparée sur ces points à la Radeon HD 5970, et non à la HD 5870. Et cette comparaison est même généreuse, car si l’on regarde simplement le niveau de bruit obtenu, on est malheureusement au niveau d’une Radeon HD 4870 X2 en charge. De loin la carte la plus bruyante de ces dernières années malheureusement. A nos yeux, le système de refroidissement a été sous estimé et, qui sait, les partenaires de Nvidia répondront peut être à ce problème dans quelques semaines avec des cartes disposant de systèmes de refroidissement plus adaptés, quitte à utiliser trois slots si nécessaire. Ou d’attendre une révision B du processeur graphique GF100 qui arriverait à en réduire la consommation. Pas la peine de se mentir, un tel stepping est déjà en cours d’élaboration et pourrait arriver pour la fin de l’été, même si avec les antécédents de TSMC, il est difficile de parler de dates.

Notre sentiment est donc partagé sur ce lancement.

source ; erenumerique.fr

Citation :

En effet, si les performances sont supérieures à celles d’une carte avec HD 5870, la consommation, le bruit et le dégagement calorifique sont également un cran au dessus et pouvoir dompter la chaleur dégagée par le GF100 n’est pas chose aisée. Nos tests ont tous été effectués sans boîtier dans une pièce à 20/21°C et atteindre 96°C en charge dans ces conditions nous parait excessif. Abandonnez tout de suite l’idée d’un boîtier silencieux sans ventilo car cette carte ne le supportera sans doute pas.

source ; revioo.com

[#63009b]Les performances :[/#63009b]Moyenne des perfs source TechPower avec un petit rajout de couleur rouge/vert pour mieux distinguer ati de nvidia :

CPU: Intel Core i7-920 @ 3.33GHz

Motherboard: Intel DX58SO (Intel X58)

Chipset Drivers: Intel 9.1.1.1015 (Intel)

Hard Disk: OCZ Summit (120GB)

Memory: Patriot Viper DDR3-1333 3 x 2GB (7-7-7-20)

Video Drivers: NVIDIA ForceWare 197.13

NVIDIA ForceWare 197.17

AMD Catalyst 10.3a

OS: Windows 7 Ultimate 64-bit

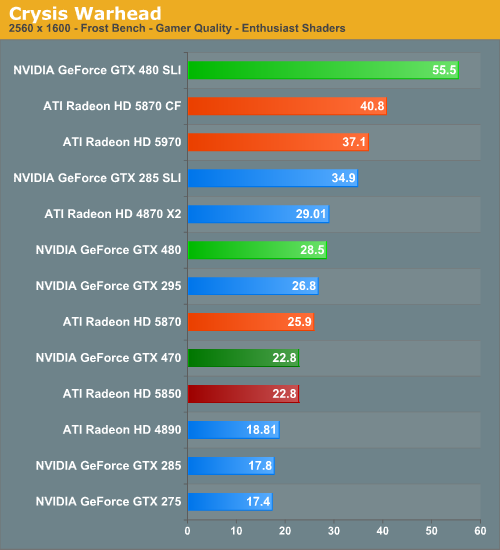

Et un autre de Anandtech concernant le fameux Crysis sur config :

CPU: Intel Core i7 920 @ 3.8 GHz

(Bloomfield, 8192 KB Cache)

Motherboard: Gigabyte X58 Extreme

Intel X58 & ICH10R

Memory: 3x 2048 MB Mushkin Redline XP3-12800 DDR3

@ 1520 MHz 8-7-7-16

Harddisk: WD Raptor 740ADFD 74 GB

Power Supply: BFG ES-800 800W

Software: Windows 7 64-bit

Drivers: NVIDIA: 195.62

ATI: Catalyst 9.12

GTX 480: 197.17 [#63009b]La conso :[/#63009b]

[#63009b]La conso :[/#63009b]

[#71008d]Dossiers officiels :[/#71008d]

==>

http://www.nvidia.com/object/fermi_architecture.html==> Partie technique PDF officiel ;

http://www.nvidia.com/content/PDF/fermi ... epaper.pdf[#71008d]Dossiers de presse en preview :[/#71008d]

==>

http://www.hardware.fr/articles/782-1/n ... rique.htmlCitation :

Que penser de ce GF100 ? Va-t-il représenter une révolution ? Un flop ? Des réactions mitigées ? De notre côté nous opterons plutôt pour cette dernière option principalement parce que 6 mois après les Radeon HD 5800, les attentes seront importantes et ce dans les jeux actuels, ce qui est logique. AMD a placé le niveau de performances très haut, un niveau difficile à égaler lorsque de nombreuses innovations architecturales sont mises en place. Elles demandent en général quelques petites adaptations et surtout un travail important au niveau de l’optimisation des pilotes.

==>

http://www.clubic.com/article-320504-1- ... cture.html==>

http://www.pcper.com/article.php?aid=858&type=expert==>

http://anandtech.com/video/showdoc.aspx?i=3721==>

http://www.hardwarecanucks.com/forum/ha ... scope.html**********

vieilles previews :

http://www.anandtech.com/video/showdoc.aspx?i=3651http://www.pcper.com/article.php?aid=789http://www.techreport.com/articles.x/17670****************

****************

[#71008d]

Les news :[/#71008d]

****************

****************

Le 27 Février 2010 ; Lancement des cartes reporté à mi-2010 ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7345530Le 02 Février 2010 : Les noms des futures cartes sont dévoilés ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7312687Le 25 Janvier 2010 : On apprend que nvidia bosse sur la seconde génération Fermi... Mais ça ce n'est pas une surprise. En revanche ce qui l'est c'est qu'elle pourrait débarquer en 2010 !! Alors même que la première génération n'est pas encore sortie, ce qui laisse présager une durée de vie très courte. ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7302789Le 18 Janvier 2010 : Le plein d'informations en attendant les tests ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7292567Le 30 Septembre 2009/1er Octobre 2009 : Le GT300 désormais connu sous le nom de code Fermi, ne vise pas prioritairement le marché des cartes graphiques pour joueurs, mais avant tout le marché professionnel.

==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7141617Le 25 Septembre 2009 : la production de GT300 commencera à la mi-octobre ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t7133452Le 16 Mai 2009 : le GT300 est "taped out" en version A1 ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6959938Le 14 Mai 2009 : article très très intéressant expliquant la situation avec le GT300 et le RV870 ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6956063Le 11 Mai 2009 : TSMC semble être le principal obstacle du GT300 et risque de morfler commercialement parlant ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6953134Le 06 Mai 2009 : Le GT300 repoussé à début 2010 pour le "parfaire" ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6946534Le 23 Avril 2009 : L'info tombe, le GT300 sera bien une bête de combat dotée de ... 512 SPs !! ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6930814Le 10 Avril 2009 : UMC est le premier fondeur à avoir réussi à mettre au point un procédé de gravure 40nm haut de gamme parfaitement fonctionnel avec une réduction de la consommation de prés de 65% par rapport au 65nm. UMC est prêt pour la production en série... TSMC va tirer la gueule ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6915504 Le GT300 quant à lui sera "Tape out" vers Juin 2009 ==>

http://forum.hardware.fr/hfr/Hardware/2 ... m#t6915153GT300 Dx11 40nm pour la fin de l'annéeNvidia is working on what looks to be its first DirectX 11 card and as it was the case before, Nvidia will start with DirectX 11 in the ultra high-end and it will pass it on to slower cards at a later date. The codename that we've heard is a quite logical one, GT300, and this card will help Nvidia to fight and eventually take the performance crown in ultra high-end market.

We do know that ATI should have its high end DirectX 11 at a similar date, and in the meantime both companies will focus more on cheaper cards in 2009, as the year of the Ox will probably be a good year for selling cheaper and more affordable stuff. All of the cards to launch in next three quarters in mainstream and entry-level will stick with DirectX 10 or 10.1, depending who are you talking about.

Many of you know that high-end helps selling entry level and mainstream, and it is rather important who wins this round, but it is still way too early to tell.

http://www.fudzilla.com/index.php?optio ... 6&Itemid=1Le 18 Janvier 2009 : http://www.hardware-infos.com/news.php?news=2663 GT300 prévu pour le Q4 2009, avec le support de DX11 et Cuda 3.0. Les unités ne seraient plus SIMD, mais MIMD. Le GT300 sera le vrai successeur du G80 et un saut de type NV40 ou G80, contrairement au GT200 qui n'était qu'un G80 gonflé. Merci à Marllt2 pour l'info.

Le 05 Janvier 2009 : Le site allemand Hardware-Infos vient de publier ce qui serait la quasi-totalité des caractéristiques du GT212, la future puce haut de gamme de NVIDIA. Commençons par le quand, ce nouveau GPU serait prévu pour le second trimestre 2009. Contrairement au GT200b de la GeForce GTX 285, il s'agirait d'une évolution conséquente. Le GT212 serait gravé en 40 nm, disposerait de

[#ff0000]1.8 milliard de transistors[/#ff0000], tout en étant nettement plus petit que son prédécesseur, avec des dimensions qui n'excéderaient pas 300 mm². Il compterait 384 processeurs de flux et 96 unités de textures mémoires.

Il s'agirait toujours d'une puce DirectX 10.

Pour finir, NVIDIA passerait enfin à la GDDR5, celle-ci serait cadencée à 1250 MHz (5000 MT/s), cela sur un bus 256 bits. Sur le papier, cela semble très intéressant, reste à voir si ces informations sont confirmées... et ce que cela donne réellement !

source :

http://www.matbe.com/actualites/56721/nvidia-gt212/****************************************

*****************************************************

*****************************************************************

info au passage sur dx11 (pour le GT300) :

DirectX 11 supportera les cartes DX9

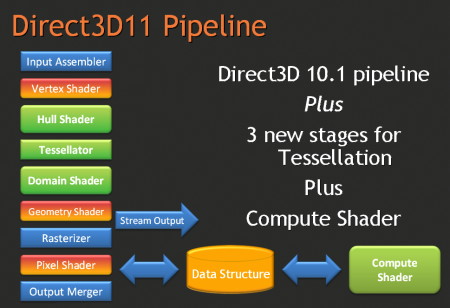

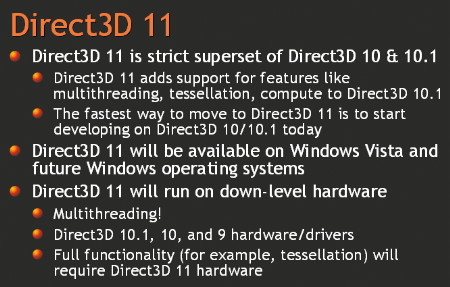

Cet été, Microsoft a dévoilé plus de détails sur sa prochaine API graphique : DirectX 11 ou plutôt Direct3D 11. Pour rappel, les principales nouveautés apportées par cet API sont le support de la tesselation, le support des Compute Shaders et une refonte de l'API pour pouvoir mieux multi-threader la partie rendu graphique d'un moteur.

La tesselation permet d'affiner la géométrie pour éviter l'aspect anguleux des objets ou des paysages en subdivisant la géométrie. Ce maillage plus complexe peut également être utilisé pour ajouter des détails via le Displacement Mapping. Le GPU de la Xbox 360 ainsi que toutes les Radeon HD intègrent une unité fixe de tesselation. Celle-ci ne sera cependant pas compatible avec DirectX 11 qui requiert plus de programmabilité.

Cette programmabilité ne prend cependant pas place au niveau de l'unité de tesselation en elle-même qui sera une unité fixé, mais via 2 nouveaux types de shaders, les Hull Shaders et les Domain Shaders, qui prennent place avant et après la tesselation. Dans ce sens, DirectX 11 représente donc un superset de la tesselation des Radeon HD. Autrement dit l'exploiter aujourd'hui avec les Radeon HD permettra aux développeurs de réutiliser et d'étendre leur travail avec DirectX 11, de quoi peut être enfin les pousser à s'y intéresser.

Les Compute Shaders représentent, eux, un type de shader dédiés au calcul plus ou moins généraliste. Ils peuvent s'exécuter en dehors du pipeline graphique mais peuvent s'interfacer très facilement avec celui-ci. Leur structure est très proche du code CUDA dont Microsoft s'est probablement inspiré. Ils devraient permettre de faciliter l'utilisation des GPUs pour la physique et le traitement d'image grâce puisqu'il s'agit d'un language standardisé ouvert à tous.

Au sujet de ces nouvelles fonctionnalités de DirectX 11, les esprits critiques noteront qu'elles ajoutent 3 nouveaux types de shaders spécifiques ainsi qu'une nouvelle unité fixé, ce qui va quelque peu à contre courant de l'évolution du rendu 3D…

Optimiser l'API pour une meilleure exploitation des CPUs multicores est probablement l'aspect le plus prometteur de ce DirectX 11. Un point qui a fait passer inaperçu un petit détail lié : DirectX 11 réintroduira le support de DirectX 9.

Avec DirectX 10, Microsoft avait fait table rase du passé, ce qui implique qu'un moteur DirectX 10 ne pouvait supporter que les cartes graphiques DirectX 10. Avec DirectX 11, les cartes graphiques DX10.1, DX10 et DX9 pourront être utilisées, en étant bien entendu limitées aux fonctions qu'elles supportent et via un tout nouveau driver.

DirectX 9 étant très différent de DirectX 10 au niveau de l'API, il reste à voir si ce support sera performant. Il est probable qu'il soit limité au niveau DX9, Shader 3.0 (sans aucune option) et que le tout soit moins performant que de passer par l'API DX9 native. Reste que cela simplifiera fortement le travail des développeurs et qu'il est possible que la meilleure utilisation des CPUs multicores compense l'efficacité moindre. Bien entendu il faudra que Nvidia, AMD et Intel acceptent de développer des pilotes DirectX 11 pour leurs cartes DirectX 9 pour que tout ceci se concrétise.

source :

http://www.hardware.fr/news/lire/24-10-2008/ Si vous êtes Fanboys qui veu avoir la plsu grosse---> Gogo SLI GTX480 mais prévoir la soufflerie

Si vous voulez vraiment la plus grosse --> CrossfireX de HD5970 (moins de soufflerie et moins de conso)